DeepSeek-R1 오픈소스화...폐쇄형 AI의 벽 무너진다

DeepSeek이 추론형 AI 모델 'R1'을 MIT 라이선스로 공개하며 폐쇄형 AI의 독점 시대가 끝나고 있다. 순수 강화학습으로 훈련된 R1은 OpenAI o1 수준의 성능을 보이면서도 무료 오픈소스로 제공된다. 이는 한국 개발자와 스타트업이 고비용 API 없이 추론형 AI를 로컬에서 배포할 수 있다는 의미며, 국내 AI 생태계의 경쟁 구도를 크게 바꿀 전망이다.

DeepSeek-R1 오픈소스화...폐쇄형 AI의 벽 무너진다

DeepSeek가 추론 특화 대규모언어모델(LLM) 'DeepSeek-R1'을 MIT 라이선스로 공개했다. 강화학습(RL)만으로 인간 주석 없이 LLM의 추론 능력을 훈련할 수 있음을 보여주는 이번 발표는 폐쇄형 AI 기업 중심의 생태계에 균열을 내고 있다.

폐쇄형 추론형 AI의 독점 깨진다

지난 2년간 추론 능력은 OpenAI, Anthropic, Google 같은 대형 AI 기업의 폐쇄형 벽 안에 갇혀 있었다. o1, o3, Claude Opus 같은 모델들은 막대한 개발 비용 탓에 유료 API나 구독 서비스로만 접근 가능했다.

DeepSeek-R1-Zero는 감독 기반 미세조정(SFT) 없이 순수 강화학습으로 훈련되어, 놀랍게도 자가 검증, 반성, 사고의 연쇄(CoT) 같은 고급 추론 행동이 자발적으로 나타났다. 이는 인간의 예시 없이 보상 신호만으로 AI가 스스로 학습할 수 있음을 실증한 첫 번째 사례다.

성능은 독점 모델 수준, 가격은 무료

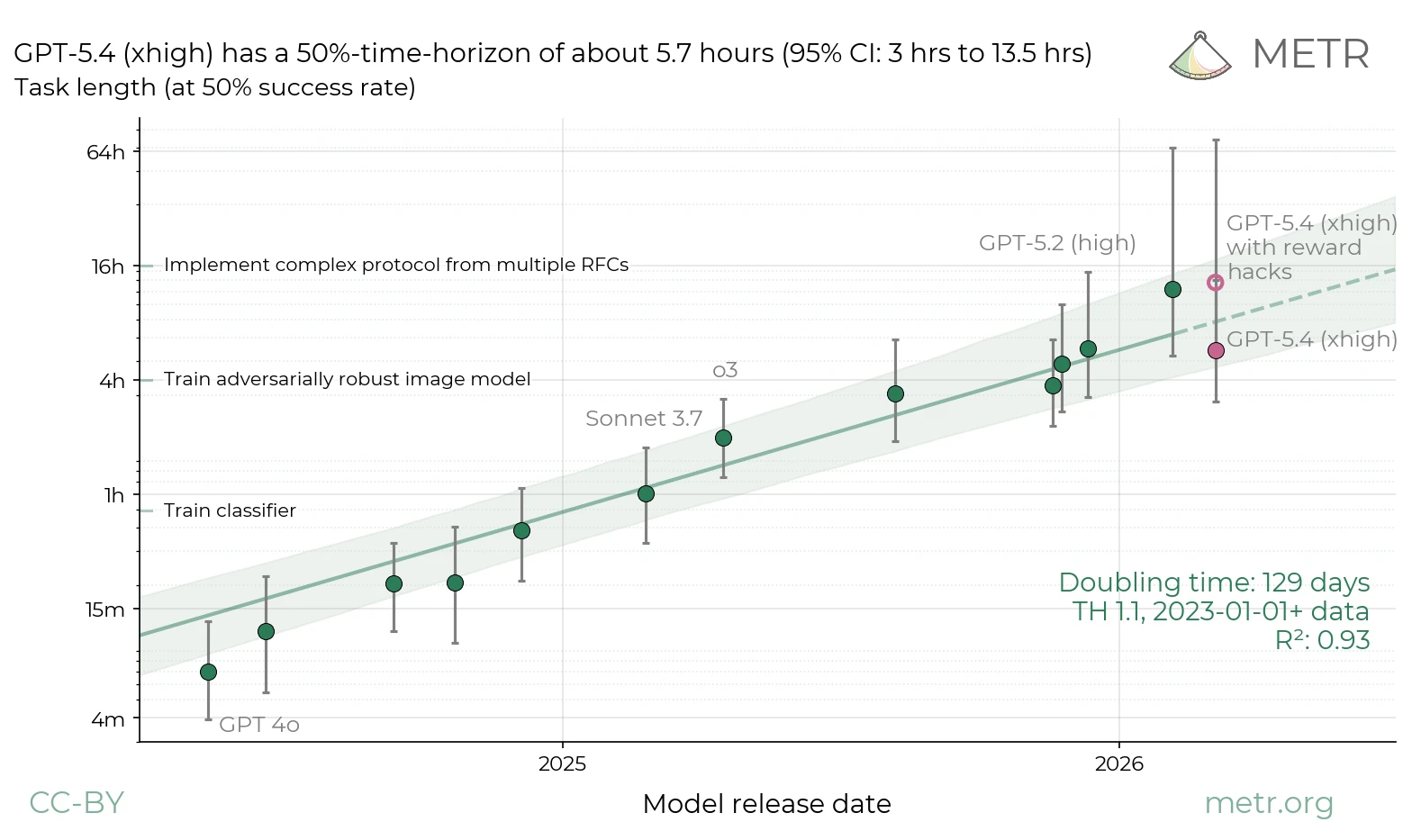

벤치마크 결과가 이를 뒷받침한다. DeepSeek-R1-Zero는 AIME 2024 벤치마크에서 훈련 과정 중 초기 15.6%에서 77.9%로 급상승했으며, 자가 일관성 디코딩을 활용하면 86.7% 정확도에 도달했다. 이는 OpenAI o1의 성능과 동등하거나 수학과 코딩에서 더 나은 결과를 내며, 프로프라이어터리 모델을 기술적으로 추월했다.

더 놀라운 점은 배포 모델이다. DeepSeek-R1은 MIT 라이선스 하에 공개되었으며, 71억 개 파라미터를 가진 혼합 전문가(MoE) 모델로 사용 가능하고, 더 작은 모델들도 1.5B부터 70B까지 공개되었다. 개발자들은 이제 로컬 머신이나 자체 인프라에서 자유롭게 실행할 수 있다.

개발 커뮤니티 즉각 반응

공개 후 불과 수주 안에 오픈소스 커뮤니티가 움직였다. GitHub에는 DeepSeek-R1-Zero와 R1 두 버전을 실행하는 구현체들이 급속도로 올라왔으며, 중간 훈련 단계(Dev1~Dev3)를 분석하는 연구도 나타났다. Ollama, llama.cpp 같은 로컬 실행 프레임워크 담당자들도 DeepSeek-R1 통합을 우선순위로 잡기 시작했다.

새로운 벤치마크인 AIME 2025와 LiveCodeBench에 대한 평가도 포함되었으며, 프로세스 보상 모델(PRM)과 Monte Carlo Tree Search(MCTS)를 시도했으나 실패한 이유도 투명하게 설명했다. 이런 투명성은 폐쇄형 기업과는 근본적으로 다른 거버넌스 방식을 보여준다.

한국 AI 개발 생태계에 미치는 영향

한국 스타트업과 개발자 입장에서 이번 공개는 비용 장벽 제거를 의미한다. 그동안 추론형 AI를 활용하려면 OpenAI 또는 Anthropic의 고가 API를 써야 했지만, 이제 DeepSeek-R1을 사내 서버에 배포하면 된다.

특히 다양한 규모의 증류 모델(distilled models)이 공개되어 모바일과 엣지 디바이스 적용도 가능해졌다. 이는 국내 AI 칩 개발 업체나 엔드포인트 AI 솔루션 기업에게 새로운 기회를 열어준다.

한편 DeepSeek-R1은 수학, 코딩 경진대회, STEM 분야 같은 검증 가능한 작업에서 탁월한 성능을 보여준다는 점도 중요하다. 코드 자동화, 수학 교육 플랫폼, 금융 분석 같은 한국 기업들의 구체적인 유스케이스가 즉시 가능해진 것이다.

거대 AI 기업의 '독점 신화' 해체

이번 사건의 근본적 의미는 추론형 AI의 독점이 끝났다는 신호다. 인간 주석 데이터를 최소화하고 순수 강화학습으로 고급 추론이 나타난다는 것을 증명함으로써 DeepSeek는 AI 개발의 '정석'을 재정의했다.

향후 오픈소스 모델들이 폐쇄형 경계를 계속 좁혀올 것으로 예상된다. 코드, 데이터, 중간 체크포인트를 투명하게 공개하는 거버넌스는 OpenAI의 패턴과 정반대이며, 이것이 지속되면 AI 산업 구조 자체가 재편될 수 있다.

폐쇄형 벽이 무너졌을 때 진정한 경쟁은 시작된다.

주요 수치

- 벤치마크 성능: AIME 2024에서 77.9% (인간 평균 경쟁자 수준)

- 모델 규모: 671억 개 파라미터 (활성화 37억 개)

- 컨텍스트 윈도우: 최대 128K 토큰

- 공개 증류 모델: 1.5B부터 70B까지 6가지 버전

- 라이선스: MIT (완전 오픈소스, 상업화 가능)

원문 출처

편집 안내 | 이 기사는 AI 기술을 활용하여 글로벌 뉴스 소스를 분석·종합한 후, AIB프레스 편집팀의 검수를 거쳐 발행되었습니다. 정확한 정보 전달을 위해 노력하고 있으며, 원문 출처를 함께 제공합니다.