OpenAI "SWE-bench 더 이상 코딩 능력 척도로 부적합"

OpenAI가 자신이 2024년 발표한 SWE-bench Verified 벤치마크를 신뢰도 결함으로 인해 평가 중단을 선언했다. 전문가 감사 결과 59.4%의 테스트 케이스에 결함이 있고, 모든 최신 모델이 학습 단계에서 문제와 솔루션을 이미 접했음이 드러났다. 벤치마크 오염이 점수 향상을 왜곡한다는 의미다.

OpenAI가 소프트웨어 엔지니어링 벤치마크의 신뢰성을 공식으로 포기했다. 지난 2024년 8월 발표한 'SWE-bench Verified'를 더 이상 평가 지표로 사용하지 않기로 선언한 것이다.

OpenAI의 기술 블로그에 따르면, SWE-bench Verified는 공개된 오픈소스 저장소에서 추출한 깃허브 이슈 500건을 기반으로 대형언어모델(LLM)의 자동 소프트웨어 개발 능력을 측정해왔다. 지난 6개월간 74.9%에서 80.9%로 개선되며 업계 표준 지표로 자리잡았다. 하지만 성능 향상세가 둔화되자 OpenAI는 기준의 신뢰도를 재검토했다.

그 결과는 충격적이었다. OpenAI가 감사한 138건의 문제 중 59.4%에서 치명적 결함을 발견했다. 6명 이상의 경험 많은 소프트웨어 엔지니어가 독립적으로 검증한 결과다.

구체적 결함은 두 가지다. 첫째, 테스트 케이스 자체가 과도하게 구체적이다. 전체 감사 대상의 35.5%는 기능적으로 올바른 솔루션을 거부한다. 예를 들어 특정 함수명이 명시되지 않았는데도 테스트가 그 함수를 직접 호출하도록 강제하는 식이다. pylint 저장소의 한 사례에서는 문제 설명에 없는 'get_annotation'이라는 함수명을 테스트가 import하도록 설정했다. 이론적으로 올바른 많은 해답이 import 오류로 떨어진다.

둘째, 테스트가 문제 설명에 없는 추가 기능을 확인한다. 감사 대상의 18.8%가 이런 '과도한 테스트(wide test case)' 문제를 안고 있다. sympy 저장소의 한 과제는 공식 설명상 하나의 이슈만 다루지만, 실제 테스트는 원래 PR이 해결한 세 개 이슈를 모두 검증하도록 설계됐다. 모델이 명시된 한 이슈는 올바르게 해결해도 나머지 두 이슈까지 구현해야만 통과한다.

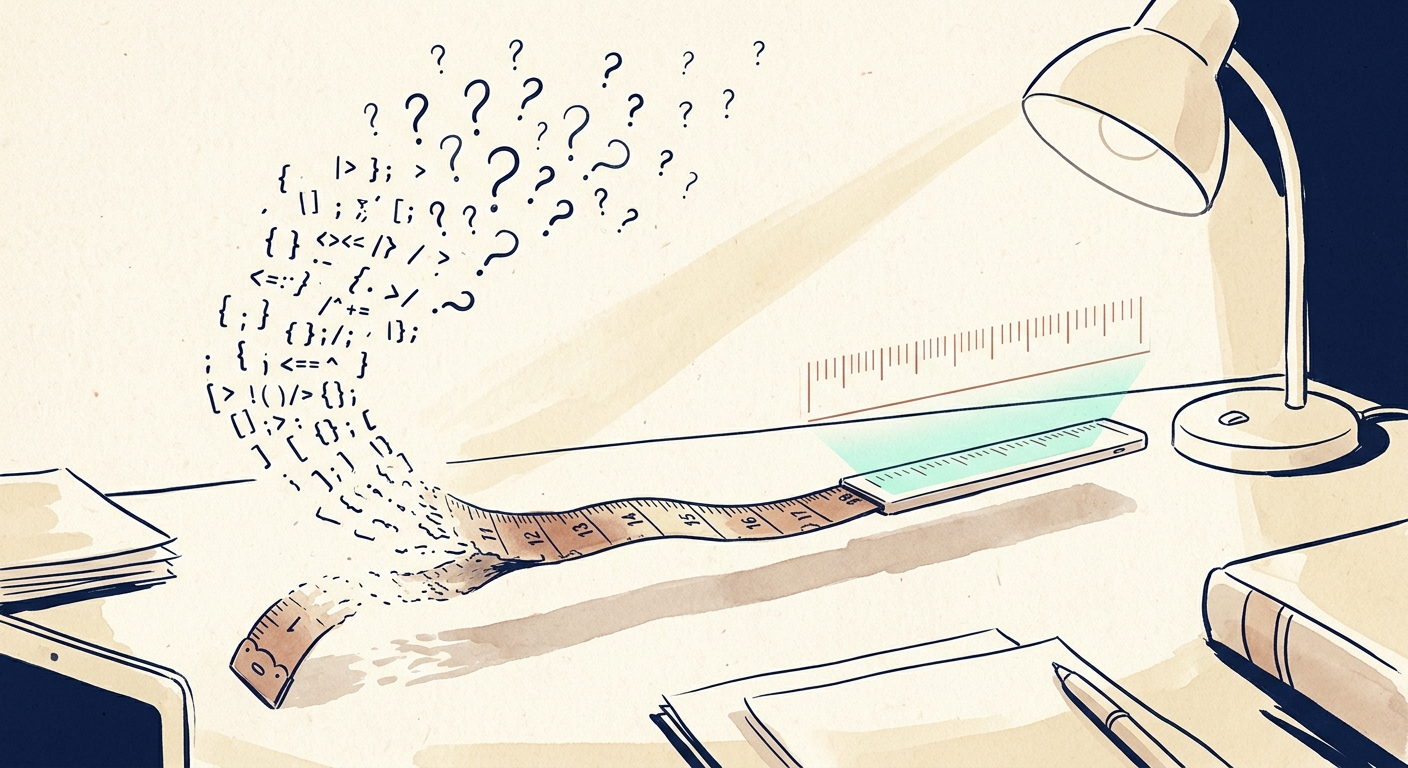

더 근본적인 문제는 데이터 오염(contamination)이다. SWE-bench의 문제와 솔루션은 오픈소스이며, 대다수 모델 개발사가 훈련에 활용하는 저장소에서 추출했다. OpenAI가 테스트한 모든 최신 모델은 원본 버그 수정(gold patch) 또는 문제 설명을 그대로 재현할 수 있었다. 즉 학습 단계에서 이미 일부 문제와 해답을 접했다는 뜻이다.

이는 벤치마크 점수 향상이 실제 코딩 능력 발전이 아닌, 훈련 데이터 노출 정도만 반영한다는 의미다. 시험 전에 학생들에게 문제지와 답안을 나눠주는 것과 같은 상황이 벌어졌다.

OpenAI는 "개선된 SWE-bench Verified도 잔존 결함을 피할 수 없었다"며 "더 이상 업계 표준으로서 기능하지 못한다"고 결론지었다. 다른 모델 개발사들도 SWE-bench Verified 보고를 중단하고, 대신 'SWE-bench Pro'를 사용할 것을 권고했다.

산업적 의미는 심각하다. 소프트웨어 개발 AI의 능력을 객관적으로 재는 척도가 무너졌다. 벤치마크 왜곡(benchmark gaming)의 폐해—점수는 오르지만 실제 능력은 안 오르는 현상—가 현실화된 것이다. LLM 시대의 평가 체계가 얼마나 허약한지를 드러낸 사건이다.

OpenAI는 "새로운 미오염 평가(uncontaminated evaluation)를 구축 중"이라며 "이 분야가 연구 커뮤니티의 중점 과제"라고 강조했다. 하지만 완성까지는 갈 길이 멀다. 그동안 코딩 능력 벤치마크는 사실상 공중에 떠 있는 상태다.

편집 안내 | 이 기사는 AI 기술을 활용하여 글로벌 뉴스 소스를 분석·종합한 후, AIB프레스 편집팀의 검수를 거쳐 발행되었습니다. 정확한 정보 전달을 위해 노력하고 있으며, 원문 출처를 함께 제공합니다.